■倫理問題、自動運転悩ます

どう判断するのかわからないAIは、倫理の問題も人間に突きつける。

「青信号を検出しました」。コンピューターが告げると、交差点で停車中のバスはゆっくりと右折を始めた。運転手の手はハンドルから離れたままだ。

群馬県桐生市で5月の土曜日、自動運転のバスなどを公道で走らせる実証実験があった。往復3・6キロの道のりを約30分かけ、公募した市民を乗せて走った。

バスは時速20キロほどに速度を抑え、後方に車がつまってたまったり路上駐車の車があったりすると、手動運転に切り替えて後続車を先に行かせた。事前に覚えこませたルートを走るように設計し、自分でルートを選ぶAIは使われていないからだ。

システムを開発した小木津武樹・群馬大准教授は「自動運転は、事故を避けるために究極の『かもしれない運転』を実現しなければいけない」と説明する。

自動運転車に暴走した車が向かってきたとする。ハンドルを右に切ればお年寄り、左に切れば赤ちゃんが犠牲になる。そのまま進めば乗客が危ない。

AIはどれを選ぶ?

貨車の暴走を想定した倫理学の思考実験「トロッコ問題」は、自動運転の開発者を悩ませてきた。小木津准教授もその一人だ。

例えば、AIを使うと野良猫も家猫も見分けることができる。でも、「野良猫と家猫を判別し、野良猫をひくなんていう判断が社会に受け入れられるとは思えない」。さらに人の場合はどうすれば? 「突き詰めるほど、袋小路の議論に入ってしまう」

ソフトバンク子会社のSBドライブは25年度までに、自動運転バス1万台を走らせる目標を立てている。車内を監視するシステムにはAIを使うが、運転関係には使っていない。

同社の佐治友基社長はその理由に「日本の車道の狭さ」を挙げる。障害物を避けようと対向車線にはみ出たとき、時速20キロの自動運転バスに対向して60キロの車が来た場合、衝突までに2、3秒の余裕しかない。「予測不能な事態に車が機転を利かせると、トロッコ問題が起きてしまう」

佐治社長は「例えば路上駐車を減らすなど、自動運転を実現するためには、受け入れる社会の理解も大切になる」と話す。

■開発・運用、ルール作り急務

AIを開発する側もブラックボックス問題に対応を迫られる。

富士通は、判断した根拠を示し、裏づけとなる文献などと結びつけるAIの研究を進めている。

富士通研究所の丸橋弘治・主任研究員は「AIが間違った推論をしているかもしれない。その判断の根拠が不明だと、説明責任を厳しく求められる自動運転や金融、医療の分野で使うのは難しい」と話す。

もしAIが自分で株価を上げる手法を学習し、意図的に株価をつり上げて稼ぐ「株価操縦」をしたら?

今の金融商品取引法では、取引責任者の人間がほかの投資家を誘い込む目的を持っていなければ、刑事罰も課徴金も科されない。

日本銀行は昨年9月、大学教授や弁護士でつくる研究会の報告書をまとめた。「自然な需給に基づかない取引が行われないように、AIの開発者や運用者に義務づけることも検討に値する」と警鐘を鳴らした。

国際的なルールづくりも始まった。経済協力開発機構(OECD)は5月22日の閣僚理事会で、AI開発について「人権や民主主義の価値を尊重する」「透明性の確保」など5原則を採択した。

OECDの専門家会合では「AIに判断をゆだねるのは、個人への悪影響がない場合に限る」といった意見が強く出された。

専門家会合の委員を務めた平野晋・中央大国際情報学部長は「利便性と安全性、そしてコストのバランスをどうとるのか。生命や人権にかかわる分野では、AIの活用のあり方についてもっと議論する必要がある」と指摘する。

社会の「インフラ」になりつつあるAIを、受け入れる側のルール整備もまた急がれている。

実際のクルマの画像を基に、ディープラーニングによる推論の結果と、推論で着目したポイントを分析すると、クルマ全体を見ているわけではないことが分かる。

タイヤとボンネットの一部、ピラーとフロントガラスといったピンポイントを認識して高い確信度で判断することもあれば、クルマの後ろに立っている木をクルマの一部と認識して確信度が下がったり、車両の大部分に着目しているにもかかわらず、判断に必要な特徴量が不足して確信度が低くなったりする場合もある。解析技術はこうした判断のプロセスを明らかにすることができる。これらを基にAIが見ていなかったポイントや、不足していた特徴量を補えるような学習データを追加すれば、効率的に追加学習を行うことができるとしている。

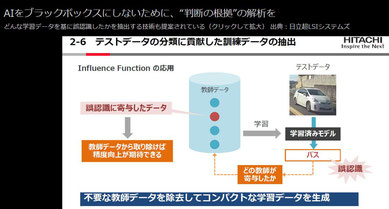

さらに、別のブラックボックス解析技術を用いると、「この画像はどの学習データのおかげ正しく分類したのか」を把握することもできるという。これを応用すれば、誤認識につながった学習データを取り除くことで精度を向上するとともに、重複するデータを排除して学習データが膨大になるのを抑え、追加学習を効率化することが期待できる。

* 日立超LSIシステムズ 組込ソリューション事業部の猪貝 光祥氏が、NVIDIAのユーザーイベント「GTC Japan 2018」(2018年9月13~14日)において、AIの品質保証に関する最新動向を紹介

※ メール・BLOG の転送厳禁です!! よろしくお願いします。

コメントをお書きください