AIは品質・信頼性確保が急務、「日本が先行している」

2019年09月02日 09時30分 更新

[村尾麻悠子,EE Times Japan]

2019年8月29~30日に開催された「イノベーションジャパン2019」(東京ビッグサイト)で、JST(科学技術振興機構)は、AI(人工知能)の最新動向を紹介するセミナーを行った。

JSTは、「機械学習が社会に実装され始めているのが第3次AIブームの大きな特長だ」と述べる。

2019年8月29~30日に開催された「イノベーションジャパン2019」(東京ビッグサイト)で、JST(科学技術振興機構)は、AI(人工知能)の最新動向を紹介するセミナーを行った。

登壇したJST研究開発戦略センター システム・情報科学技術ユニットの福島俊一氏は、AIについて「第1次、第2次のAIブームとは異なり、機械学習が社会に実装され始めているのが第3次AIブームの大きな特長だ」と述べる。

福島氏は「AIに対する期待はピークを越え、幻滅期に入りつつあるとの見方もあるが、国内外のAI関連学会の参加者数は依然として爆発的に増加している。機械学習分野の最高峰の国際会議である「NeurIPS 2018」では、申込者数がわずか11分で定員に達した」と続け、第3次AIブームの勢いが衰えていないと強調する。

社会実装で浮き彫りになった新たな技術課題

一方で、AI(特に機械学習/深層学習)の精度向上による利益も確実に大きくなっているが、社会に実装され始めたことで新たな技術課題が生まれていると指摘。国や世界レベルで、“AIの社会原則”について議論や指針の策定が進んでいると述べた。

例えば日本は内閣府が「人間中心のAI社会原則」を策定している。同様に、欧州には「Ethics Guidelines for Trustworthy AI(信頼できるAIのための倫理指針)」、IEEEには「Ethically Aligned Design(倫理的に配慮されたデザイン)」といった指針がある。

福島氏は、AIの新たな技術課題の具体例として、ブラックボックス問題、バイアス(公平性)問題、品質保証などを挙げた。

☞ ブラックボックス問題では、「人間が理解できる理由説明を出してくれない」「どんな振る舞いをするのか動作保証ができない」「事故発生時に、原因解明や責任判断ができない」といった点が懸念されている。要は、説明責任の問題だ。

☞

バイアス問題は、学習データに偏見が含まれていると、推論結果にもその偏見が反映されてしまうというものだ。2018年に、AmazonがAIを活用した人材採用システムの運用を取りやめたのは、まさにこのバイアス問題が理由だった。学習させた過去の採用データでは大多数が男性だったため、「男性を採用した方がよい」という判定ルールになってしまったのだ。

☞ 品質保証については、AIの振る舞いでは仕様が定義できないため、そもそもテストの成否を定めることが難しい。顧客との契約や出荷判定をどうすればよいかも悩ましい問題だ。

新世代のソフトウェア工学が必要に

福島氏は、機械学習のシステム開発では「パラダイムシフトが起きている」と続ける。

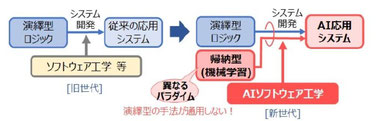

「従来のシステム開発は、手順をきちんと書くことでシステムの動作が決まるという演繹(えんえき)的な作り方だった。ところが機械学習のシステム開発は、データを与え、それを参考にしてルールを作るという帰納的な作り方になる。これまでとは違う、新しい開発方法論が必要になる」(同氏)

システム開発の手法が従来とは異なっている 出典:JST戦略プロポーザル「AI応用システムの安全性・信頼性を確保する新世代ソフトウェア工学の確率」(参考)

こうした流れを受けて、AIシステムの安全性と信頼性を確保するための、新世代のソフトウェア工学が立ち上がっていると福島氏は述べる。「JSTでは『AIソフトウェア工学』と呼んでいる。他に、“ML工学”や“ソフトウェア 2.0”という言い方もされている」(同氏)

福島氏は、AIシステムの安全性と信頼性の確保においては、日本が競争力を得られるのではないかと期待している。

「品質を確保するというところは、日本が得意な分野。実際に日本ではここ1~2年で、多くの研究コミュニティーやコンソーシアムが発足するなど、動きが急速に活発化しており、世界的に見ても先行している」(同氏)

例えば2018年4月には、「機械学習工学研究会(MLSE)」や「AIプロダクト品質保証(QA4AI)コンソーシアム」が発足している。

MLSEは、機械学習を用いたシステムの要件定義から設計、開発、運用まで、プロセス管理やテスト/品質保証の手法、プロジェクトマネジメントまで含めた包括的な取り組みを推進する。QA4AIコンソーシアムは、AI技術を用いた製品の品質保証について共通の指針を提供することを目指している。

同コンソーシアムは、「AIプロダクト品質保証ガイドライン」を作成しており、2019年5月版がダウンロード可能になっている。

福島氏は、「AI技術の性能向上だけでなく、『人間中心のAI社会原則』を満たすための研究開発への取り組みが求められる」と強調した。

Topics Link=> 想像を絶する「シロアリの女王」の虚しい最期

※ メール・BLOG の転送厳禁です!! よろしくお願いします。

コメントをお書きください

信頼性工学の求道者 (火曜日, 24 5月 2022 11:58)

ダイセルイノベーションパークの久保田邦親博士(工学)による材料物理数学再武装って品質工学と人工知能のあいの子みたいで面白いよ。統計学における正規分布の正当性とそれに反する現象のとらえ方が今まで教科書では読んだことのない視点だ。